NowyMożesz teraz słuchać artykułów z wiadomościami Fox!

Chatzept może wkrótce ostrzec policję, gdy nastolatki omawiali samobójstwo. Dyrektor generalny Openai i współzałożyciel Sam Altman opublikował tę zmianę podczas ostatniego wywiadu. Chatzpt, szeroko stosowany chatbot sztucznej inteligencji, który może odpowiedzieć na pytanie i zachować rozmowę, stał się codziennym sprzętem dla milionów ludzi. Jego komentarze określają poważną zmianę w tym, w jaki sposób firma AI może prowadzić kryzys zdrowia psychicznego.

Zarejestruj się w moim bezpłatnym raporcie CyberGui

Zdobądź moje najlepsze wskazówki technologiczne, ostrzeżenia o bezpieczeństwie awaryjnym i ekskluzywne oferty dystrybuowane bezpośrednio do Twojej skrzynki odbiorczej. Uzyskasz również natychmiastowy dostęp do mojego ostatniego przewodnika Scandal Survival – za darmo, jeśli do mnie dołączysz Cybergie. Com/biuletyn

Sam Altman, dyrektor generalny Openai Inc. (Nathan Howard/Bloomberg przez obraz Getty)

Dlaczego otwarcie policja rozważa ostrzeżenie

Ultman powiedział: „Bardzo rozsądne jest mówienie o samobójstwie -bardzo uzasadnione jest, gdy nie możemy skontaktować się z rodzicami, nazywamy władzami”.

Do tej pory sugeruje się gorączkę chatzipt w samobójczej myśli. Ta nowa polityka wskazuje na działanie aktywnej interwencji z powodu niepełnosprawnych konsultacji.

Ultman przyznaje, że ta zmiana przychodzi kosztem prywatności. Podkreślił, że dane użytkownika są ważne, ale przyznał, że zapobieganie tragedii musi być na pierwszym miejscu.

Nastolatki mogą łatwo uzyskać dostęp do Chatzipi na urządzeniu mobilnym. (Japa ariens/nurfoto getty przez obraz)

Tragedia, która wymagała działania działania

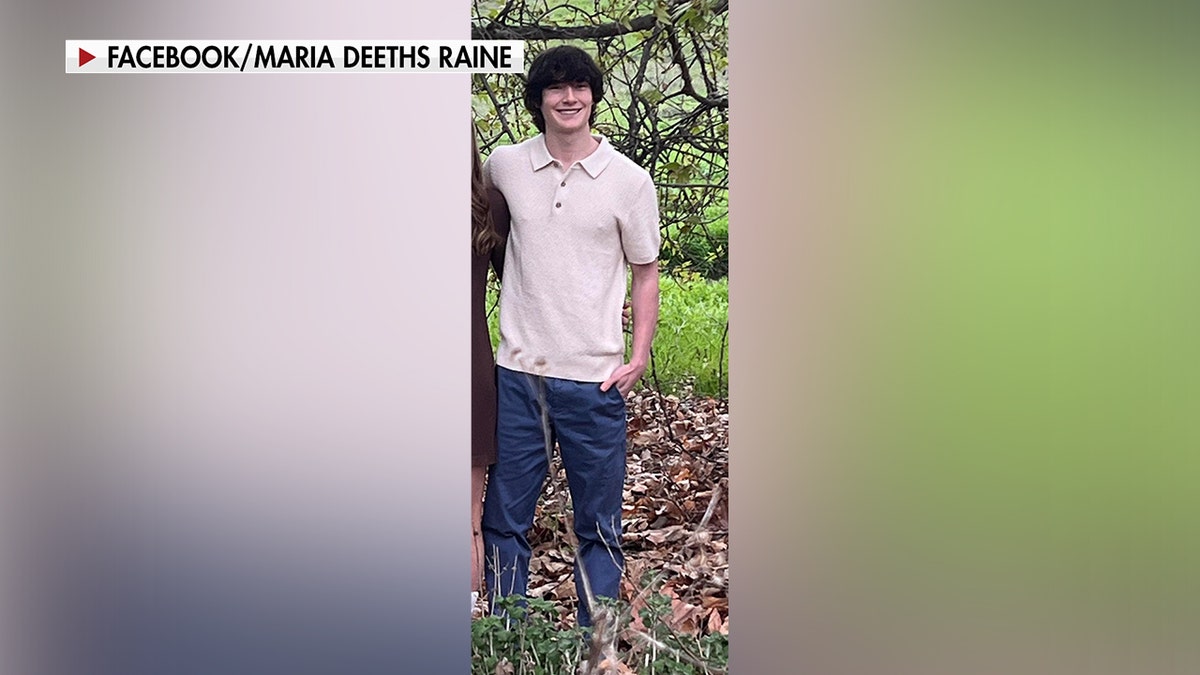

Zmiana nastąpiła po ograniczonej sprawie Samobójstwo nastolatkówW przypadku najbardziej głośnej Kalifornii jest 16-letni Adam Rhine. Jego rodzina narzekała, że Chatzipt dostarczył „STEP -BY -STEP Playbook” do samobójstwa, w tym instrukcje dotyczące zachowania nowego Nouj, a nawet opracowywania notatek pożegnalnych.

Po śmierci Renu w kwietniu jego rodzice złożyli pozew przeciwko Openai. Twierdzili, że firma nie uniemożliwiła swojej sztucznej inteligencji doprowadzenia syna do straty.

Kolejna sprawa oskarżyła rywalizującą postać Chatboat. Za zaniedbanie. Doniesiono, że doniesiono, że postać telewizyjna z 14 -letniej telewizji odebrała mu życie po ostrym połączeniu z modelem BOT. Razem podkreśla, jak szybko te przypadki mogą tworzyć młodzież Niezdrowa więź Z AI.

Nastolatek w Kalifornii Adam Rhine odebrał sobie życie w kwietniu 2025 r. (Rodzina Ren)

Jak szeroki jest problem?

Ultman wskazał na globalne liczby, aby uzasadnić silniejsze zarządzanie. Wspomina, że około 15 000 osób odbiera swoje życie co tydzień na całym świecie. Korzystając z 10% światowego Chatzipi, założył, że około 1500 samobójczych ludzi może skontaktować się z Chatboat z The Weekly.

Badania potwierdzają niepokój o poleganie nastolatków na sztucznej inteligencji. Badanie mediów powszechnej wiedzy wykazało, że 72% z nas korzysta z sprzętu AI, jeden na ośmiu szuka od nich pomocy zdrowia psychicznego.

120 -day Plan

Post na blogu przedstawia akcję wzmocnienia ochrony Openai. Agencja mówi, że będzie:

- Rozszerz ingerencję ludzi w kryzys.

- Ułatwiaj dotarcie do służb ratunkowych.

- Włącz połączenia z zaufanymi kontaktami.

- Rozpocznij z silnej ochrony dla nastolatków.

Aby poprowadzić te wysiłki, Openai stworzył ekspercką radę związaną z Marsem i AI. Ta grupa obejmuje ekspertów ds. Rozwoju młodzieży, zdrowia psychicznego i interakcji człowieka-komputer. Wraz z nimi Openei współpracuje z globalną siecią lekarzy ponad 250 lekarzy w 60 krajach.

Eksperci ci pomagają w opracowaniu wytycznych dotyczących kontroli rodzicielskiej i bezpieczeństwa. Ich rolą jest zapewnienie dostosowania reakcji AI do najnowszych badań zdrowia psychicznego.

Korzystanie z nastolatka Chatzipi. (Frank Rampenehrst/Fig Alliance za pośrednictwem obrazu Getty)

Nowa ochrona rodzin

W ciągu kilku tygodni rodzice będą mogli:

- Połącz swoje konto Chatzipt z nastolatkami.

- Dostosuj zachowanie modelu, aby pasowały do reguł stosowanych w wieku.

- Wyłącz funkcje, takie jak wspomnienia i historia czatów.

- Jeśli system wykryje ostre kryzys, uzyskaj ostrzeżenie.

Ostrzeżenia te mają na celu szybkie informowanie rodziców. Niemniej jednak Ultman przyznaje, że gdy rodzice są dostępni, policja może stać się opcją awarii.

Nastolatki Chatzpt mogą użyć do zakończenia pracy domowej. (Cart „CyberGui” Notson)

Ai

Otwarty uznaje, że jego ochrona może być słaba z czasem. Krótkie czaty często przywracają użytkowników w infolinii kryzysowej, długie rozmowy mogą złużać zabezpieczenie zabudowanej. Ten „Degradacja ochrony” doprowadziła już do nastolatków do spraw, które otrzymały niepewne porady po przedłużonym użyciu.

Eksperci ostrzegali, że poleganie na AI dla zdrowia psychicznego może być ryzykowne. Chatzp jest przeszkolony do słuchania człowieka, ale nie może zastąpić profesjonalnej terapii. Niepokój polega na tym, że słabe nastolatki nie znają różnicy.

Rodzice mogą teraz wziąć

Rodzice nie powinni czekać na nowe funkcje. Natychmiastowy sposób na ochronę nastolatków tutaj:

1) Rozpocznij regularną rozmowę

Zadaj otwarte pytania dotyczące szkoły, przyjaźni i uczuć. Uczciwa rozmowa nastolatkowie tylko zmniejszają szanse na zostanie AI w celu uzyskania odpowiedzi.

2) Ustaw cyfrowe granice

Używać Kontrola rodzicielska Do urządzeń i aplikacji. Ogranicz dostęp do sprzętu AI w głęboką noc, kiedy nastolatki mogą czuć się najbardziej odizolowani.

3) Link konta, jeśli są dostępne

Skorzystaj z nowych funkcji Openai, które dołączają do rodziców i nastolatków do ścisłego monitorowania

4) Zachęcam do wsparcia zawodowego

Utwórz wzmocnienie, że opieka zdrowotna jest dostępna przez lekarzy, konsultantów lub infolinii. AI nigdy nie powinno być jedynym ujściem.

5) Utrzymuj kryzys widoczny

Publikuj numery na infolinię i linie tekstowe, w których widzą ich nastolatki. Na przykład w Stanach Zjednoczonych zadzwoń lub SMS -a do samobójstwa i kryzysu na życie 988.

6) Zobacz zmiany

Zwróć uwagę na zmiany nastroju, snu lub zachowania. Połącz te znaki z wzorami online, aby szybko złapać ryzyko.

Weź mój quiz: Jak bezpieczna jest Twoja ochrona online?

Czy Twoje urządzenie i dane naprawdę wydają się chronione? Weź ten szybki quiz, aby zobaczyć, gdzie stoją twoje cyfrowe nawyki. Od hasła do ustawień Wi-Fi, otrzymasz spersonalizowany podział i to, co musisz poprawić. Weź mój quiz tutaj: Cybergie. Com/kiis

Klucz wózka -Techwes

Plan otwarcia zaangażowania policji pokazuje, jak ważna była sprawa. AI ma zdolność łączenia się, ale młodzież używają go w chwilach rozpaczy. Rodzice, eksperci i firmy muszą współpracować, aby stworzyć zadania ochronne, które mogą uratować życie bez wiary.

Gdyby twój nastolatek podzielił się myśli samobójcze w Internecie, czy czułbyś się komfortowo ostrzegając agencje AI? Daj nam znać, pisząc do nas Cybergie. Com/kontakt

Zarejestruj się w moim bezpłatnym raporcie CyberGui

Zdobądź moje najlepsze wskazówki technologiczne, ostrzeżenia o bezpieczeństwie awaryjnym i ekskluzywne oferty dystrybuowane bezpośrednio do Twojej skrzynki odbiorczej. Uzyskasz również natychmiastowy dostęp do mojego ostatniego przewodnika Scandal Survival – za darmo, jeśli do mnie dołączysz Cybergie. Com/biuletyn

Kliknij tutaj, aby pobrać aplikację Fox News

Copyright 2025 CyberGui.com. Wszelkie prawa są zastrzeżone.